Décidément, Google multiplie les erreurs de communication pour le moment. Après avoir fait volte-face concernant la mise à jour Google Penguin 4.0 (annoncée pour la fin d’année puis reportée), le moteur de recherche a publié une série de critères de pertinence pour le classement des listes sur Google My Business avant de les modifier.

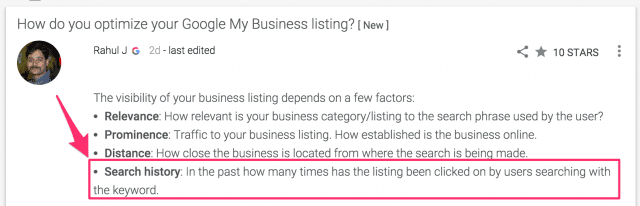

Petit problème de communication la semaine dernière au sein de la maison Google puisque Rahul J (membre de l’équipe Google My Business) a initialement publié une publication concernant le référencement local sur Google+. En effet, ce dernier a publié quatre facteurs de pertinence principaux pour gagner de la visibilité dans les fiches My Business. Il s’agissait de:

- Le pertinence (notamment les catégories utilisées)

- Le trafic sur la fiche

- Le géolocalisation

- Le taux de clics

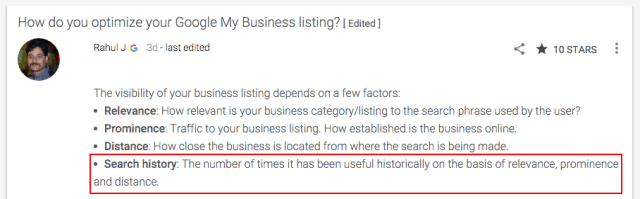

Petit hic: Google ne s’était jamais prononcé clairement sur le sujet et c’est sans doute pour cette raison que la publication a été modifiée le jour même par Rahul J. Ainsi, plutôt que de parler de « taux de clics » sur la fiche, le Googler explique qu’il s’agit « du nombre de fois où la fiche de l’entreprise a été utile historiquement en fonction de sa pertinence, de son trafic et de sa géolocalisation ». Bref, une nouvelle formulation qui ne fait que reprendre les trois premiers points et qui ne veut pas dire grand-chose au final.

Voici l’évolution de la publication:

AVANT:

APRES:

Conclusion

Comme on s’en doutait depuis longtemps, le taux de clics est bel et bien pris en compte dans l’algorithme local de Google qui permet de classer les fiches Google My Business. Mais Google ne semble toujours pas vouloir communiquer clairement et en toute transparence sur le sujet…

En début de semaine, nous avons appris que Google utilisait un algorithme basé sur des méthodes d’intelligence artificielle et d’apprentissage automatique depuis le début de l’année 2015 dans le but de trier les résultats de recherche en fonction de leur pertinence. Mais que sait-on vraiment de RankBrain ? Voici quelques éléments de réponse.

En début de semaine, nous avons appris que Google utilisait un algorithme basé sur des méthodes d’intelligence artificielle et d’apprentissage automatique depuis le début de l’année 2015 dans le but de trier les résultats de recherche en fonction de leur pertinence. Mais que sait-on vraiment de RankBrain ? Voici quelques éléments de réponse.

Ces éléments de réponse proviennent de Bloomberg (qui a dévoilé l’info) et de SearchEngineLand (qui a reçu des informations en direct de Google).

RankBrain: c’est quoi ?

Concrètement, RankBrain est le nom donné par Google à un système d’intelligence artificielle et d’apprentissage automatique (machine-learning artificial intelligence system). RankBrain est utilisé pour offrir aux internautes des résultats pertinents. Une « très grande proportion » des résultats de recherche sont gérés par RankBrain.

L’apprentissage automatique (machine learning): c’est quoi ?

L’apprentissage automatique désigne un champ d’étude de l’intelligence artificielle qui permet à une machine (un ordinateur par exemple) de s’ordonner lui-même certaines tâches (plutôt que de se les voir demandées par un humain ou en suivant un programme détaillé). Les machines peuvent ainsi accomplir des tâches impossibles à remplir par des moyens algorithmiques plus classiques.

Qu’est-ce que l’intelligence artificielle ?

L’intelligence artificielle (souvent abrégée par I.A.) désigne la capacité d’un ordinateur à être aussi intelligent qu’un être humain (du moins pour acquérir des connaissances, établir de nouvelles connexions, etc.).

En ce qui concerne RankBrain, il semblerait que l’apprentissage automatique et l’intelligence artificielle soient presque synonymes.

RankBrain est-il le nouvel algorithme de recherche de Google ?

Non, RankBrain n’est pas un nouvel algorithme mais s’intègre plutôt dans l’algorithme global du moteur de recherche de Google. L’algorithme de Google s’appelle Hummingbird (nom donné au milieu de l’année 2013 par le moteur de recherche) et permet de trier des milliards de pages en fonction de leur pertinence.

Il semblerait donc que RankBrain fasse désormais partie de l’algorithme général Hummingbird. En effet, l’article de Bloomberg indique clairement que RankBrain ne gère pas toutes les recherches et qu’il ne s’agit que « d’un des signaux inclu dans l’algorithme pour déterminer les résultats qui apparaissent sur le moteur de recherche de Google ainsi que leur positionnement ».

Parmi les autres éléments qui font partie de l’algorithme général Hummingbird, on trouve des filtres antispam bien connus des spécialistes en référencement naturel comme Google Panda, Google Penguin ou Google Payday Loan, des éléments qui ont pour but d’améliorer la pertinence des résultats locaux (Google Pigeon), des éléments qui récompensent les sites mobile-friendly (Google Mobile-Friendly) ou encore des éléments qui visent à lutter contre la violation des droits d’auteur (Google Pirate).

Et le PageRank alors ?

Comme RankBrain, le PageRank fait partie de l’algorithme général de Google. Il s’agit d’un élément qui détermine la pertinence des pages en fonction des liens qui pointent vers elles.

PageRank est certainement l’élément le plus connu de l’algorithme de Google car c’est le premier nom que Google a donné à un élément de son algorithme. Cela date déjà de 1998.

RankBrain: le 3e critère de ranking le plus important ?

Si on en croit l’article de Bloomberg, cette affirmation est exacte. L’article cite Greg Corrado, un ingénieur travaillant chez Google:

« RankBrain is one of the « hundreds » of signals that go into an algorithm that determines what results appear on a Google search page and where they are ranked, Corrado said. In the few months it has been deployed, RankBrain has become the third-most important signal contributing to the result of a search query, he said ».

Conclusion

RankBrain est donc une énième surcouche de l’algorithme principal de Google, mais une surcouche particulièrement importante si on en croit les dires de son ingénieur, Greg Corrado.

Cette surcouche vise à analyser et à comprendre les contenus avec plus de pertinence. Cela peut paraître quelque peu inquiétant, mais cela signifie également que les contenus des sites web seront encore plus importants dans le futur.

Ces derniers jours, Barry Schwartz a remarqué à plusieurs reprises que de nombreux webmasters faisaient écho de mouvements notables au sein des résultats de recherche de Google au sein du forum spécialisé WebmasterWorld. Une mise à jour a-t-elle été lancée récemment par le moteur de recherche ?

D’après les informations recueillies sur le forum WebmasterWorld, les premiers signes de cette éventuelle mise à jour ont été aperçus aux alentours du 17 septembre et, depuis lors, de nombreux internautes s’intéressant au référencement naturel ont confirmé ces changements massifs. S’agit-il d’une mise à jour lancée par Google ? Difficile à dire à présent car même si certains indicateurs ont montré une certaine hausse de la volatilité des SERP autour du 23 septembre, personne n’a confirmé ces analyses chez Google.

Comme l’indique Barry Schwartz sur son blog, il se pourrait bien que Google soit actuellement en train de tester une nouveauté ou que le moteur de recherche lance une mise à jour en douceur mais rien ne nous permet, pour le moment, de confirmer la rumeur. Est-ce en relation avec Google Panda ? Avec Google Penguin ? Avec un autre algorithme du moteur de recherche ? Difficile à dire pour le moment mais les internautes qui s’expriment sur le forum WebmasterWorld cherchent déjà à donner un nom à ces fluctuations du mois de septembre (notamment l’update Tedster, du nom de ce spécialiste SEO décédé en 2013).

Il semblerait que la mise à jour impacte essentiellement des sites de niche d’après les informations recueillies sur WebmasterWorld. Et vous, avez-vous également remarqué des fluctuations importantes au sein des résultats de recherche de Google ? N’hésitez pas à en discuter dans les commentaires ci-dessous car vous n’êtes sans doute pas le seul dans la situation.

EDIT: Il se pourrait que ces fluctuations soient dues aux mises à jour de Google visant les contenus piratés

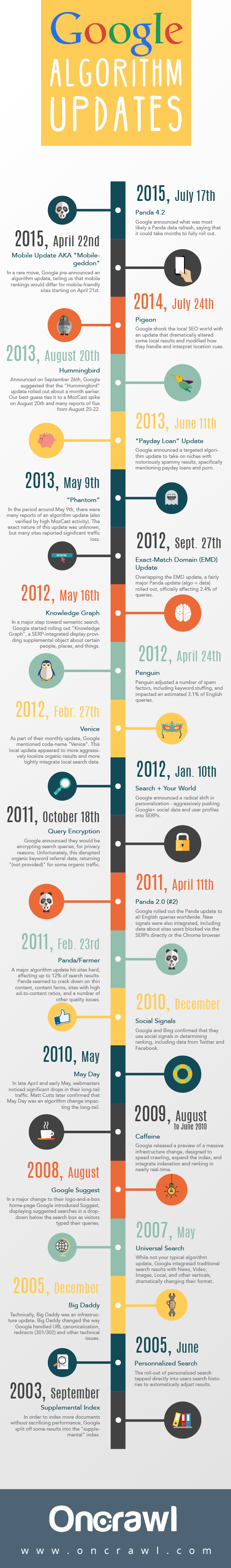

Cela fait maintenant longtemps que Google effectue régulièrement des mises à jour de son algorithme et de ses filtres antispam. OnCrawl a décidé de compiler ces différentes mises à jour dans une infographie claire et (presque) complète. On y retrouve aussi bien Google Panda que Google Penguin, Google Hummingbird, Google Mobile-friendly ou Google Phantom.

Quand on s’intéresse au référencement naturel, il est essentiel d’en comprendre l’histoire et l’évolution car ce n’est pas du jour au lendemain que Google est parvenu à offrir aux internautes des résultats aussi pertinents que ceux affichés actuellement. Non, il a fallu mettre l’algorithme à jour à de nombreuses reprises, lancer des filtres antispam et faire évoluer la recherche sur le web en général.

Afin de faire la lumière sur les différentes étapes qui ont permis à Google de devenir le moteur de recherche qu’il est aujourd’hui, OnCrawl a décidé de dresser une ligne du temps des principales mises à jour du célèbre moteur de recherche. « Principales » car l’infographie ne mentionne pas toutes les mises à jour mineures qui ont eu lieu au cours des 12 dernières années mais bien les principales évolutions du moteur de recherche. Pour découvrir en détails les différentes mises à jour de Google Panda, nous vous invitons à cliquer ici et pour celles de Google Penguin ici.

Voici l’infographie complète des principales mises à jour de Google:

La semaine dernière, nous vous indiquions que de nombreux webmasters avaient remarqué des changements importants au sein des résultats de recherche de Google. Pourtant, s’il avait déclaré qu’il y avait bien eu une mise à jour, le moteur de recherche avait indiqué qu’il ne s’agissait ni de Panda, ni de Penguin, ni de l’algorithme HTTPS. Pour SearchMetrics, ce sont surtout les sites d’actualité qui auraient gagné en visibilité au cours de la mise à jour…

La semaine dernière, nous vous indiquions que de nombreux webmasters avaient remarqué des changements importants au sein des résultats de recherche de Google. Pourtant, s’il avait déclaré qu’il y avait bien eu une mise à jour, le moteur de recherche avait indiqué qu’il ne s’agissait ni de Panda, ni de Penguin, ni de l’algorithme HTTPS. Pour SearchMetrics, ce sont surtout les sites d’actualité qui auraient gagné en visibilité au cours de la mise à jour…

Comme on le sait tous, Google réalise plusieurs centaines de mises à jour de son algorithme chaque année et la plupart d’entre-elles passent inaperçues auprès du grand public et des spécialistes SEO. Cependant, la semaine dernière, une mise à jour inconnue a éveillé l’attention de nombreux webmasters à cause de son impact non-négligeable.

Le moteur de recherche est rapidement intervenu afin d’indiquer qu’il ne s’agissait pas d’une mise à jour célèbre comme Panda, Penguin, HTTPS ou autre mais qu’il y avait bien eu une actualisation de l’algorithme du moteur de recherche (sans préciser laquelle évidemment…). Pour en apprendre davantage sur le sujet, Marc Tober (de SearchMetrics) a réalisé une analyse un peu plus profonde qui met en évidence que cette mise à jour aurait surtout bénéficié aux sites d’actualité.

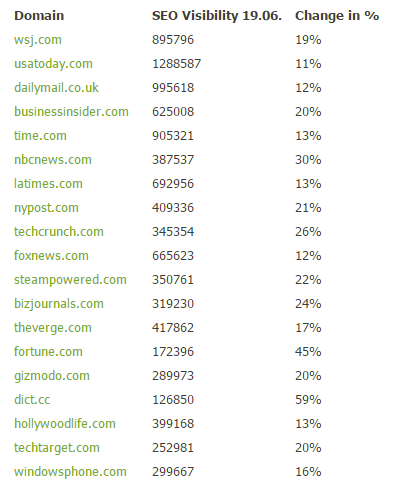

D’après les données relayées par SearchMetrics, on remarque que de nombreux sites d’actualité ont bénéficié d’une hausse de visibilité au sein des résultats de recherche de Google. Voici les évolutions remarquées suite à la mise à jour du 17 juin 2015:

Vous détenez des sites d’actualité ? Avez-vous également remarqué une évolution positive du trafic provenant de la recherche organique ainsi qu’une amélioration du positionnement de vos sites web ?

On notera enfin que cette mise à jour est survenue en même temps que l’annonce du lancement d’un Google Trends en temps réel. Simple coïncidence ou relation de cause à effet ? Difficile à démontrer à l’heure actuelle…

Source: Search Engine Land

Le SMX Advanced se déroule pour le moment à Seattle et à cette occasion Gary Illyes a effectué quelques révélations concernant Google Panda. Selon lui, le filtre du moteur de recherche devrait être actualisé dans les prochaines semaines.

Le SMX Advanced se déroule pour le moment à Seattle et à cette occasion Gary Illyes a effectué quelques révélations concernant Google Panda. Selon lui, le filtre du moteur de recherche devrait être actualisé dans les prochaines semaines.

Préparez-vous à la prochaine mise à jour de Google Panda ! C’est en substance ce que Gary Illyes a expliqué lors d’une conférence tenue au SMX Advanced de Seattle. D’après le Webmaster Trends Analyst de Google, cette actualisation des données de Google Panda pourrait être déployée dans deux, trois ou quatre semaines (autrement dit dans le courant du mois de juin ou de juillet).

Autre élément à ressortir de cette conférence: le fait qu’il ne s’agira pas d’une réécriture de l’algorithme Google Panda mais bien d’une mise à jour de ses données. Donc les sites qui souffrent actuellement d’une pénalité relative à Google Panda pourraient très bien retrouver une certaine visibilité dans les semaines à venir. A l’inverse, de nouveaux sites pourraient évidemment être sanctionnés par cette nouvelle mise à jour.

Pas de mise à jour automatique de Google Panda ?

Pour rappel, Google avait annoncé il y a quelques mois qu’il cherchait à actualiser les données de ses filtres automatiquement de manière à ce que les webmasters pénalisés ne doivent pas attendre de nombreux mois avant de retrouver leur visibilité. Cependant, plus récemment, John Mueller avait fait marche arrière en indiquant que ces mises à jour devaient encore être déployées manuellement.

Voici ce que déclarait John Mueller dans un Hangout du mois d’avril 2015:

« I think both of those algorithms [Panda & Penguin] currently are not updating the data regularly. So that is something for both of them, where we kind of have to push updates as well. »

Si vous pensez que votre site a été pénalisé par Google Panda, il n’est pas trop tard pour effectuer les modifications qui lui permettront de sortir de pénalité ! N’hésitez pas à nous contacter pour plus d’informations sur ces mises à jour !

Au cours du mois de mars de cette année, Google a annoncé qu’il allait probablement déployer un algorithme qui aurait pour objectif de détecter et pénaliser les pages satellites (doorway page en anglais). Finalement, cette mise à jour semble avoir été lancée à la fin du mois d’avril comme l’avait indiqué Seroundtable. Mais en quoi consistent ces pages satellites et à quoi faut-il prêter attention pour ne pas se faire pénaliser ?

Si les webmasters et tous ceux qui s’intéressent de près ou de loin au domaine du référencement ont bien compris l’objectif des filtres Google Panda et Google Penguin, l’algorithme Page Satellite (Doorway Page) est moins évident à comprendre. En effet, il est parfois difficile d’appréhender la différence entre une page traditionnelle et une page sur-optimisée afin de manipuler l’algorithme de Google.

Si les webmasters et tous ceux qui s’intéressent de près ou de loin au domaine du référencement ont bien compris l’objectif des filtres Google Panda et Google Penguin, l’algorithme Page Satellite (Doorway Page) est moins évident à comprendre. En effet, il est parfois difficile d’appréhender la différence entre une page traditionnelle et une page sur-optimisée afin de manipuler l’algorithme de Google.

En début de semaine, un sujet intéressant concernant l’algorithme Doorway Page a été lancé sur le forum Webmaster Central de Google. L’internaute qui a lancé le sujet se demandait si le fait de proposer des noms de domaine incluant un tag géographique afin d’offrir du contenu plus pertinent aux consommateurs intéressés et une gestion plus simple pour les webmasters était une bonne solution (exemple: www.hiltonmonterey.com au lieu de hiltongardeninn3.hilton.com).

Le jour même, un internaute a répondu à ce message et sa réponse a été marquée comme « meilleure réponse » par Eric Kuan, un employé de chez Google. En d’autres mots, cela nous permet de savoir plus précisément ce que Google entend par Page Satellite (Doorway Page). Voici la réponse « validée » par Eric Kuan:

« Those aren’t doorway’s, no. There’s nothing deceptive or manipulative that I can see. An exemple of doorways is when you have a website with 200 pages on it, all of which have the same basic text but with place names switched out on each page (« Find a taxi in London »/ »Find a taxi in New York City »). The pages are designed to rank separately, catch keyword searches, but funnel all the traffic to on destination.

Whether this way of doing things is a good idea is another matter – since you effectively have two different indexed pages/sites (both are indexed) competing with one another. It would generally make more sense to have one of the URLs 301 redirecting to the other – and making one strong site instead of two. »

En d’autres mots, cet internaute indique qu’il ne s’agit pas d’un cas de Doorway Page car ces derniers concernent essentiellement les sites qui comptent des centaines de pages avec des textes identiques mais avec des géolocalisations différentes (« trouver un taxi à Londres »/ »trouver un taxi à New York City »).

Cependant, la manière de procéder dans la situation en question n’est peut-être pas la bonne non plus parce qu’il y a deux pages qui se battent pour le même mot clé. Il pourrait donc être intéressant de faire une redirection 301 de l’une vers l’autre afin de rendre le site restant encore plus fort.

Pour davantage d’informations sur les pages satellites, n’hésitez pas à vous rendre sur cette page explicative fournie par Google.

Nous approchons doucement mais sûrement de la sortie du nouvel algorithme de Google concernant la recherche mobile et, aujourd’hui, nous en savons un peu plus à ce sujet.

Nous approchons doucement mais sûrement de la sortie du nouvel algorithme de Google concernant la recherche mobile et, aujourd’hui, nous en savons un peu plus à ce sujet.

Pour rappel, la sortie de cet algorithme est annoncée pour le 21 avril 2015 et on sait qu’il travaillera page par page et en temps réel. Ce que l’on ignore (ou plutôt que l’on ignorait), c’était la durée du lancement ou comment être certain à 100 % d’être compatible mobile !

Grâce à un Hangout paru hier sur Google + (que vous pouvez retrouver en intégralité ci-dessous), nous avons appris 3 informations assez importantes :

Comment se déroulera le lancement ?

L’algorithme sera lancé le 21 avril 2015 mais contrairement à ce que l’on pouvait penser, il faudra plusieurs jours, voire une semaine pour qu’il soit totalement opérationnel.

Pas de demi-mesure pour la compatibilité mobile !

Les sites seront « Mobile-Friendly » ou ne le seront pas mais il n’y aura pas de site « à moitié compatible » ou de « pourcentage de compatibilité ». Sachant que ce nouvel algorithme aura plus d’impact que Panda et Penguin, il sera impératif de vérifier la compatibilité mobile de votre site, ce qui nous amène au troisième et dernier point:

Comment vérifier et être certain que son site est « Mobile-Friendly » ?

En ce qui concerne les Etats-Unis, il sera possible de tester la compatibilité de son site en vérifiant qu’il obtient le label « Mobile-Friendly » dans les résultats de recherche mobile.

En ce qui nous concerne (puisque ce label n’est pas encore déployé en Belgique), nous devons utiliser l’outil dédié que Google a mis à notre disposition plutôt que d’utiliser les « Mobile Usability Reports » dans Google Webmaster Tools car ce dernier possède un délai, qui a pour conséquence de ne pas prendre en compte vos derniers changements effectués dans son rapport.

Si votre site ne passe pas le test de compatibilité mobile, n’hésitez pas à nous contacter pour éviter de perdre votre trafic!

Comme vous l’avez certainement appris en lisant les dernières actualités relatives au référencement, un algorithme Mobile-Friendly sera déployé prochainement par Google. Et d’après les dernières informations relayées par Zineb Ait Bahajji, Webmaster Trends Analyst chez Google, l’impact de ce futur algorithme risque d’être plus important que celui de Google Penguin ou de Google Panda !

Comme vous l’avez certainement appris en lisant les dernières actualités relatives au référencement, un algorithme Mobile-Friendly sera déployé prochainement par Google. Et d’après les dernières informations relayées par Zineb Ait Bahajji, Webmaster Trends Analyst chez Google, l’impact de ce futur algorithme risque d’être plus important que celui de Google Penguin ou de Google Panda !

Nous vous l’expliquions sur notre blog à la fin du mois de février: Google va déployer un algorithme de compatibilité mobile à partir du 21 avril prochain. Conséquence de cette nouveauté: tous les sites qui ne sont pas compatibles pour mobiles aux yeux de Google risque de perdre de la visibilité dans les résultats de recherche mobiles au profit des sites mobile-friendly.

Si l’on en croit les derniers propos des employés de Google à propos de cette mise à jour, ce nouvel algorithme risque d’avoir un impact très important dans les résultats de recherche puisque Zineb Ait Bahajji a indiqué lors d’une conférence au SMX de Munich qu’il aurait un effet plus grand que Panda ou Penguin.

Ce message a rapidement été tweeté par Aleyda Solis :

Zineb from Google at #smx Munich about the mobile ranking update: is going to have a bigger effect than penguin and panda!

— Aleyda Solis (@aleyda) March 17, 2015

Pour rappel, Google Panda avait réussi à avoir un impact sur 12% des résultats de recherche et Google Penguin sur 4% de celles-ci lors des mises à jour les plus importantes.

Si votre site n’est pas encore mobile-friendly ou que vous avez un doute à ce sujet, rendez-vous très rapidement sur cette page pour faire le test !

Testez votre site internet

La réponse du test est négative ? Contactez-nous au plus vite afin de rendre votre site mobile-friendly avant le 21 avril et évitez ainsi de perdre un trafic précieux !

D’après les dernières informations que nous avons trouvé sur SeroundTable et sur le forum spécialisé WebmasterWorld, il semblerait qu’une mise à jour soit actuellement en train d’être déployée par le moteur de recherche de Google, et ce depuis le mercredi 4 février.

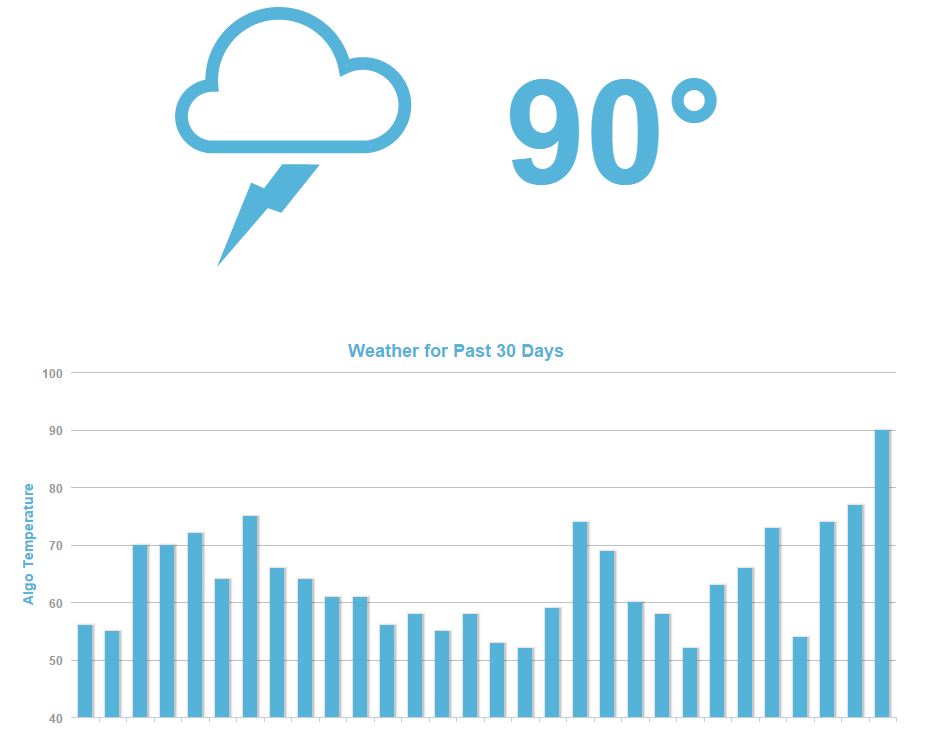

Depuis ce mercredi, de nombreux webmasters ont remarqué des évolutions marquées au sein des résultats de recherche, notamment des retours de sites web qui avaient disparus depuis plusieurs mois. D’ailleurs, pour preuve que de nombreux mouvements ont émaillé les SERPs ces dernières heures, les outils de tracking automatique ont tous remarqué des variations significatives. C’est notamment le cas de MozCast:

De Algooroo:

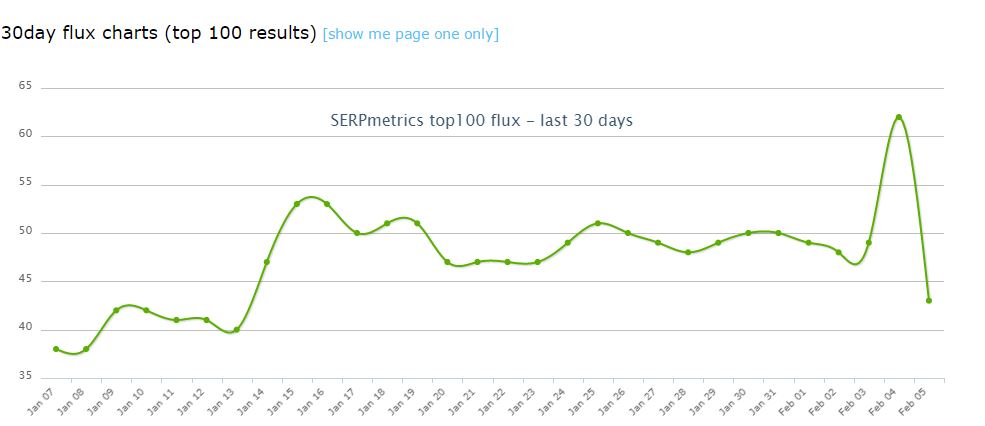

Ou encore de SerpMetrics:

Beaucoup d’activités sur les forums

Comme on l’expliquait ci-dessus, beaucoup de webmasters se sont tournés vers les forums afin de partager les changements aperçus au reste de la communauté SEO. Et comme souvent dans ces cas-là, on a pu y découvrir une multitude de commentaires allant dans tous les sens. Certains expliquant qu’il s’agissait d’une mise à jour qui ressemblait à Panda, d’autres de mouvements qui avaient tendance à faire reculer Wikipédia, etc.

Au final, Google est sorti de son mutisme en expliquant d’abord que le moteur de recherche continuait à opérer quelques réglages mais qu’il n’y avait pas de mise à jour spécifique à annoncer.

Puis, un peu plus tard, le moteur de recherche a affirmé à Barry Schwartz que les mouvements remarqués par la communauté SEO n’avaient rien à voir avec une quelconque mise à jour Panda ou Penguin.

Vous avez aussi remarqué des mouvements dans les SERP ces derniers jours? N’hésitez pas à partager vos remarques dans les commentaires ci-dessous ou contactez-nous si vous souhaitez obtenir une expertise de votre site par nos soins 😉