Google Panda et Google Penguin, cela vous dit quelque chose ? Non ? Pourtant ils pourraient bien être la cause d’une perte de visibilité de votre site internet. En effet, ce sont en gros, respectivement une mise à jour et un filtre de Google pour améliorer la qualité des résultats de son moteur de recherche.

Google Panda est d’abord apparu en 2011 pour éliminer les sites de faible qualité (ils référençaient tout et n’importe quoi) des premiers résultats de la recherche.

Ensuite, il y a quelques mois, Google a mis sur pied le filtre Google Penguin. L’objectif d’ améliorer la qualité des résultats en s’attaquant aux stratégies peu opportunes des référenceurs.

En somme, si on n’est pas un spécialiste du référencement, la différence entre les deux n’est pas toujours très claire. Ce qu’il faut retenir de cela, c’est que ces deux améliorations ont affecté le référencement de plusieurs milliers de sites web. Certains ont perdu pas mal de visibilité alors que d’autres sont passés entre les mailles du filet.

Avez-vous connu des problèmes de référencement depuis leur apparition ? Avez-vous connu une diminution du trafic de votre site internet ? Êtes-vous moins bien positionné qu’auparavant sur le moteur de recherche ?

Si c’est le cas, n’hésitez pas à contacter Referenceur.be, nous pourrons vous aider à redonner une nouvelle dynamique à votre site.

Aujourd’hui, nous vous proposons un petit rafraîchissement autour du sujet SEO. Car même si vous êtes un utilisateur averti, oublier les règles fondamentales du SEO peut s’avérer dangereux pour le renommée de votre site. Et si vous commencez seulement à travailler dans le référencement naturel, nous vous conseillons de lire attentivement ce qui suit.

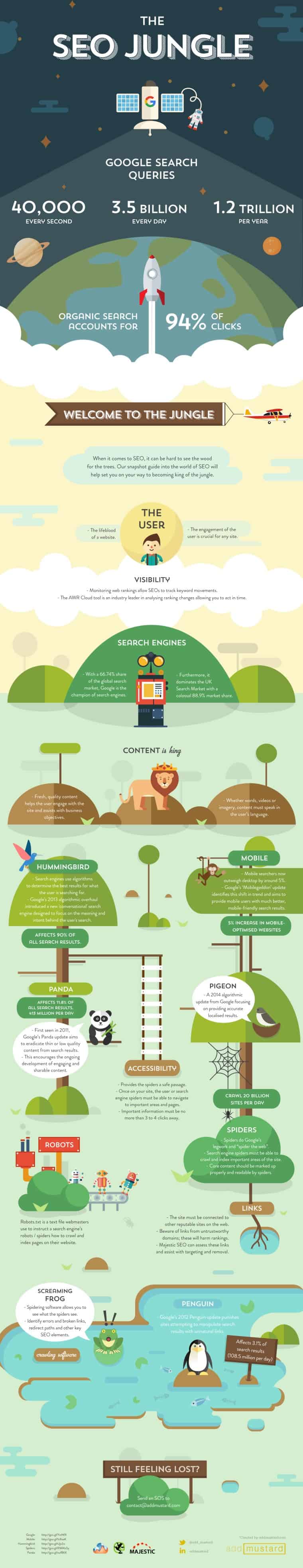

L’infographie ci-dessous, création de l’agence addmustard, a pour vocation de reprendre les éléments importants de la branche SEO sous la forme amusante d’une jungle. Vous y trouverez l’ensemble des animaux et autres personnages symbolisant les mises à jour des algorithmes des moteurs de recherche, surtout ceux de Google.

Parmi les chiffres frappants, nous relevons que chaque seconde quelques 40 000 recherches sont effectuées, et qu’au bout d’un jour elles atteignent le nombre faramineux de 3,5 milliards ! La grande majorité des clics (94% quand même) est à attribuer à la recherche organique. Le panda, policier du contenu sous son apparence tranquille, touche environ 11,8% de l’ensemble des résultats, soit 413 millions de requêtes par jour. Pensez donc à écrire du contenu de qualité pour vos lecteurs. Parmi l’ensemble des sites existants, environ 20 milliard de sites par jour sont crawlés par les spiders. N’oublions pas de citer le pingouin qui veille à ce que des liens naturels soient utilisés, et non pas des liens obtenus de manière douteuse. Il touche environ 3,1% de l’ensemble des résultats, soit 108,5 millions de requêtes par jour.

Nous vous invitons donc à sauter dans la jeep internet et de parcourir le safari du SEO. Bonne route !

Il y a deux jours, un Hangout en anglais a été posté par l’équipe des webmasters de Google afin d’apporter des informations complémentaires concernant la prochaine mise à jour (21 avril 2015) de l’algorithme de Google, concernant la recherche mobile.

Il y a deux jours, un Hangout en anglais a été posté par l’équipe des webmasters de Google afin d’apporter des informations complémentaires concernant la prochaine mise à jour (21 avril 2015) de l’algorithme de Google, concernant la recherche mobile.

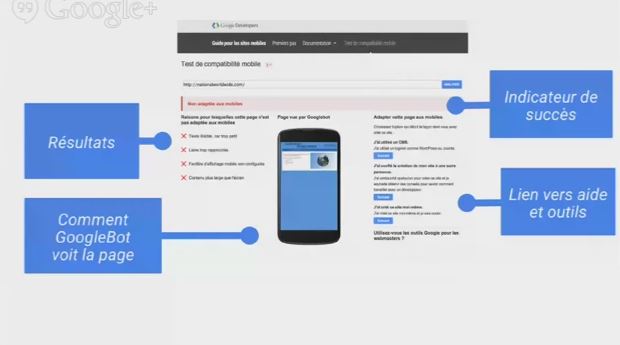

Hier, c’était au tour de l’équipe francophone de Google de nous proposer un Hangout en français (voir ci-dessous) afin de nous offrir un récapitulatif de toutes les informations concernant l’algorithme de compatibilité mobile. Voici donc un résumé de tout ce qui a été dit dernièrement.

Le lancement

Le déploiement de ce nouvel algorithme se fera comme vous le savez le 21 avril 2015 mais il lui faudra plusieurs jours, voire une semaine afin d’être opérationnel à 100 %. On a également appris que son lancement sera effectué mondialement (et non pas d’abord aux Etats-Unis puis dans le reste du monde comme Google le fait souvent).

Méthode de travail et impact

Pas d’impact sur desktop

Il faut tout d’abord noter que l’algorithme ne touchera que la version mobile du moteur de recherche et non la version « desktop ». N’oubliez pas que les recherches sur mobile représentent environ 50% des requêtes traitées chaque jour par Google. On notera également que cet algorithme pourrait avoir plus d’impact que la sortie de Panda ou Penguin !

Concerne uniquement les smartphones

Google précise également que la compatibilité visée concerne les smartphones et non les tablettes. Il recommande donc de continuer à fournir une version « desktop » sur ces dernières.

Un algorithme qui travaille page par page

Le nouvel algorithme (qui, pour l’instant, n’a toujours pas reçu de nom d’animal) travaillera « page par page« et il sera donc tout à fait possible d’avoir une page compatible pour mobile (qui sera donc mieux positionnée par Google) sans pour autant avoir l’entièreté de son site compatible mobile. Les pages non optimisées ne seront pas pénalisées à proprement dit, mais elles seront mises en retrait par rapport à celles qui le seront.

En ce qui concerne la compatibilité mobile d’une page, il faut savoir qu’il n’y a pas d’entre-deux. Soit elle est à 100% compatible, soit elle ne l’est pas.

Un algorithme en temps réel

En plus de cela, l’algorithme travaillera en temps réel: dès que le Googlebot visitera une page de votre site, il lui donnera directement le label « Mobile-Friendly » ou non. Tout dépendra de la fréquence de son passage sur vos pages.

Devenir « Mobile-Friendly »

La vitesse de chargement des pages ne sera pas prise en compte par l’algorithme. Cependant, un chargement lent de vos pages (surtout sur mobile) risque de gâcher l’expérience de vos internautes. Nous vous recommandons donc d’en tenir compte malgré tout.

Afin de vérifier si votre site est compatible mobile, il faut qu’il obtienne le label « Mobile-Friendly » (pas encore disponible en Belgique) ou bien qu’il passe le test mis à disposition par Google. Préférez ce dernier au « Mobile usability Reports » de Webmaster Tools.

Testez votre site internet

Si votre site n’est toujours pas « Mobile-Friendly » ou si vous avez encore des questions concernant le sujet, n’hésitez pas à nous contacter !

Comme chaque semaine, le chef de l’équipe antispam de Google que tous les webmasters connaissent aujourd’hui, notre cher Matt Cutts, revient avec une nouvelle vidéo visant à fournir une aide aux webmasters de sites internet.

Comme chaque semaine, le chef de l’équipe antispam de Google que tous les webmasters connaissent aujourd’hui, notre cher Matt Cutts, revient avec une nouvelle vidéo visant à fournir une aide aux webmasters de sites internet.

Et cette semaine, le sujet traité par Matt Cutts devrait intéresser tous les spécialistes du référencement puisqu’il répond à une question d’un internaute qui se demande si les backlinks (les liens entrants) vont perdre de l’importance dans le futur.

Voici la question originale posée par Leah, un webmaster originaire de New York :

Google changed the search engine market in the ’90s by evaluating a website’s backlinks instead of just the content, like others did. Updates like Panda and Penguin show a shift in importance towards content. Will backlinks lose thier importance ?

Dans la vidéo publiée par Matt Cutts sur la chaîne Youtube de Google Webmaster (que vous pouvez découvrir en intégralité ci-dessous), le chef de l’équipe antispam de Google explique que les backlinks vont petit à petit devenir moins important au fur et à mesure que le temps passe.

En effet, si l’analyse des backlinks sera encore utilisée pendant des années dans l’algorithme de Google, le moteur de recherche explore aujourd’hui d’autres voies pour déterminer si une page web correspond aux attentes des utilisateurs. Pour le moment, Google analyse les backlinks de la page, la réputation du site internet et des pages ou encore la qualité du contenu qui se trouve sur une page particulière.

Mais Google veut aller encore plus loin pour offrir les résultats les plus pertinents aux internautes et le moteur de recherche travaille donc sur l’Author Rank pour déterminer le niveau d’expertise de l’auteur de la page, sur le langage naturel afin que Google comprenne le sens d’une requête sans se focaliser sur des mots clés spécifiques.

Matt Cutts conclu cette vidéo en expliquant que les liens continueront à faire partie de l’algorithme de classement de Google afin de déterminer la réputation d’une page web mais que l’importance de ces liens sera de moins en moins forte.

Découvrez ci-dessous la vidéo complète de Matt Cutts :

Quand on travaille le référencement d’un site web, on sait pertinemment qu’il faudra passer du temps pour renforcer le maillage externe du site web car trouver des liens de bonne qualité est de plus en plus difficile depuis que Google a affiné sa politique de linking en pénalisant de nombreux sites web.

Quand on travaille le référencement d’un site web, on sait pertinemment qu’il faudra passer du temps pour renforcer le maillage externe du site web car trouver des liens de bonne qualité est de plus en plus difficile depuis que Google a affiné sa politique de linking en pénalisant de nombreux sites web.

Comme l’explique Nick Stamoulis dans un article publié sur SearchEngineJournal, ce n’est pas parce qu’on trouve une opportunité de lien que ce lien est bon et qu’il faut sauter sur l’occasion. En effet, de nombreux types de liens de ne valent pas la peine de prendre le temps de les mettre en place.

Voici 3 types de liens qui ne valent pas la peine qu’on perde du temps pour les optimiser :

1. Le lien qui ne sera jamais vu par un internaute

Encore aujourd’hui, de nombreux « spécialistes » du référencement font des liens juste pour bénéficier d’un peu plus de jus vers leur site web dans l’espoir de monter dans les résultats de recherche. Cependant, il faut bien garder à l’esprit que le web compte aujourd’hui des milliards et des milliards de page et que beaucoup d’entre-elles ne sont jamais visitées par des êtres humains.

Avant de faire un lien, il faut donc s’assurer que la page sur laquelle se trouvera le lien pourra réellement être vue par un internaute lambda. Si ce n’est pas le cas, Google risque bien de passer par là un jour ou l’autre et pourra tout à fait pénalisé le lien inutile.

2. Le lien qui provient d’un site spammy

Cela coule de sources pour de nombreux référenceurs et c’est difficile de croire que certaines personnes essaient toujours d’obtenir des liens sur ce type de sites web depuis que Penguin a été mis en place mais il est bon de rappeler que les sites web spammy ou les réseaux de blogs doivent être évités lorsqu’on cherche à faire un peu de link-building pour son site web.

Et pour toutes les entreprises qui cherchent à faire du référencement : ne tombez pas dans le panneau des offres qui proposent des milliers de liens pour quelques euros : cela n’en vaut pas la peine !

3. Le lien qui n’a rien à voir avec votre site web/votre secteur d’activité

De manière générale, il est évident que si un lien a pour objectif de vous connecter avec les lecteurs d’un site web, ce site web doit nécessairement avoir un rapport avec votre secteur d’activité. En effet, quelles sont les chances qu’un lecteur qui se trouve sur un site sportif clique sur un lien concernant le référencement des entreprises ?

Les meilleurs liens sont ceux qui sont susceptibles d’apporter du trafic à votre site internet. C’est donc sur ceux là qu’il est nécessaire de se concentrer.

Et vous, quel est votre avis ? 🙂

Du 21 au 24 octobre se déroulait le salon Pubcon à Las Vegas, un salon où des conférences sur les médias et leur optimisation se concentrent depuis bientôt quinze années (la première édition a eu lieu en 2000). Cette année, Matt Cutts, le chef de l’équipe antispam de Google, n’a pas hésité à parler SEO et spam durant ses interventions. Voici quelques sujets qui ont été abordés.

Du 21 au 24 octobre se déroulait le salon Pubcon à Las Vegas, un salon où des conférences sur les médias et leur optimisation se concentrent depuis bientôt quinze années (la première édition a eu lieu en 2000). Cette année, Matt Cutts, le chef de l’équipe antispam de Google, n’a pas hésité à parler SEO et spam durant ses interventions. Voici quelques sujets qui ont été abordés.

PS : nous ne reprendrons pas ici tous les sujets qui ont été abordés par Matt Cutts mais vous pouvez les retrouver dans cet article de Searchenginewatch.

Hummingbird, Panda et autorship

Dans son intervention, Matt Cutts a affirmé que selon lui, beaucoup de publications de blogs à propos de comment ranker avec Hummingbird n’étaient pas pertinents. Pour Matt Cutts, et contrairement à ce que certains disent, ce nouvel algorithme n’a pas un énorme impact au niveau du SEO. D’ailleurs, personne ne l’a remarqué alors que cela fait plus d’un mois qu’il a été lancé.

A côté de cela, Panda a été adouci ces derniers mois comme l’ami Matt l’avait expliqué au mois de mai, juste avant l’été, ce qui veut dire que certains sites de qualité qui ont été touché par Panda il y a quelques mois pourront éventuellement voir leurs sites retrouver leur places dans les résultats de recherche de Google.

Enfin, Matt Cutts a parlé de de l’authorship. Nous vous en parlions pas plus tard que mercredi dans notre article où nous mettions en avant les pratiques SEO viables sur le long terme : Google cherche a booster l’autorité à travers l’autorship. Durant ce Pubcon, Matt a confirmé que Google se dirigeait vers cette direction et que l’autorship deviendrait de plus en plus important pour la visibilité dans les résultats de recherche.

Enfin, Matt Cutts a parlé de de l’authorship. Nous vous en parlions pas plus tard que mercredi dans notre article où nous mettions en avant les pratiques SEO viables sur le long terme : Google cherche a booster l’autorité à travers l’autorship. Durant ce Pubcon, Matt a confirmé que Google se dirigeait vers cette direction et que l’autorship deviendrait de plus en plus important pour la visibilité dans les résultats de recherche.

Les résultats de recherche du mobile

Matt Cutts a également discuté du rôle des smartphones et de leur impact sur les résultats de recherche en expliquant qu’il s’agit d’un domaine au sein duquel les référenceurs devront faire attention. En effet, le chef Cutts a clarifié la situation en insistant sur le fait que les sites web qui ne seront pas « mobile-friendly » verront un impact négatif sur leur positionnement dans les résultats de recherche sur mobile.

Parmi les éléments qui seront pris en considération selon Matt Cutts, on trouve notamment la question du Flash et de son poids ou encore la vitesse de chargement pour les smartphones.

On ne peut qu’être d’accord avec l’importance qui doit être accordée à la recherche sur mobile qui ne fera qu’augmenter dans les prochaines années.

Penguin et les stratégies de spam

Matt Cutts a déjà parlé beaucoup de ce qu’il fallait faire ou ne pas faire dans sa stratégie de linking dans ses vidéos (sans pour autant être vraiment clair à ce sujet). Au Pubcon, Matt Cutts a expliqué que le travail de Google consistait à éliminer le spam des résultats de recherche de Google et qu’aujourd’hui le moteur de recherche travaillait sur des mots clés assez précis tels que « payday loans » (prêt sur salaire ?), « car insurrance » (assurance voiture), « mesothelioma » (mésothéliome) et des mots clés « porno ».

La raison de cet « acharnement » sur ces mots clés résulte du fait que ce sont des recherches qui peuvent générer de grosses sommes d’argent, ce qui attire inévitablement les spammeurs. C’est donc pour cette raison que Google tente de travailler sur ces requêtes pour qu’elles soient non-spammées.

Le PageRank

Enfin, concernant le PageRank, Matt Cutts a expliqué que le « pipeline » qui est utilisé pour offrir les données est cassé et Google n’a personne qui travaille dessus pour le réparer actuellement. Autrement dit, les nouvelles ne sont pas bonnes pour les adeptes de cet indice de popularité et de qualité du site.

Il n’y aura donc pas de mise à jour prochaine du PageRank, pas cette année en tout cas. On ne sait d’ailleurs pas dire s’il y aura encore des mises à jour car Google va d’abord analyser l’impact que cela aura de ne pas l’actualiser.

La vidéo complète de ce discours de Matt Cutts ci-dessous :

Si vous suivez un peu l’actu du SEO (Search Engine Optimization), vous n’êtes pas sans savoir que ce domaine est en constante évolution. Il suffit de jeter un regard dans le rétroviseur et se souvenir de toutes les mises à jour qui ont été effectuées depuis deux ans et demi et la première mise à jour de Google Panda pour s’en rendre compte.

Si vous suivez un peu l’actu du SEO (Search Engine Optimization), vous n’êtes pas sans savoir que ce domaine est en constante évolution. Il suffit de jeter un regard dans le rétroviseur et se souvenir de toutes les mises à jour qui ont été effectuées depuis deux ans et demi et la première mise à jour de Google Panda pour s’en rendre compte.

En l’espace de quelques mois, les techniques et les pratiques des spécialistes SEO ont dû évoluer et les référenceurs ont dû s’adapter pour ne pas que leurs sites perdent leurs positions dans les résultats de recherche de Google. Plus particulièrement, on peut dire qu’on est passé d’une stratégie où presque toutes les formes de liens (soumissions à des annuaires en tous genres) et de contenus (contenus dupliqués) étaient acceptées à une rigueur bien plus élevée dans le domaine.

D’après nous, les stratégies de référencement vont encore évoluer au cours des prochains mois mais certains éléments actuels devraient être pérennes. Si on analyse un peu ce que Google nous raconte depuis plusieurs mois, on remarque que l’élément central du référencement est aujourd’hui la qualité, aussi bien au niveau de la rédaction du contenu que dans les stratégies de netlinking. Le but de Google au final ? Se débarrasser du spam (quelle que soit sa forme) et améliorer l’expérience de l’utilisateur.

Nous voyons plusieurs pratiques rester viables sur le long terme en référencement. Nous vous en proposons 5 ci-dessous mais n’hésitez pas à nous en proposer d’autres dans les commentaires ci-dessous (évitez les ancres optimisées ;)).

Mettre l’accent sur le contenu

Nous essayons de relayer la plupart des vidéos publiées par Matt Cutts afin de tenir au courant tous les débutants et spécialistes SEO des actualités et des conseils pour un meilleur ranking sur Google. Evidemment, si Matt Cutts n’est pas toujours très précis dans ses vidéos, on remarque que depuis qu’il en publie sur Youtube, il met sans cesse en évidence l’accent sur le contenu de haute qualité (vous pouvez retrouver toutes les vidéos de Matt Cutts ici).

De notre côté, nous n’avons cessé de le répéter également : Google exige un contenu de qualité supérieur, un contenu qui informe et qui offre des données pertinentes.

La prévalence de l’autorité

Cette question est liée à celle du contenu puisque Google donne une importance croissante à la question de la paternité du contenu dans l’espoir que les spammeurs puissent de moins en moins facilement rester anonyme (comme Matt Cutts l’expliquait dans une vidéo relayée par Arobasenet il y a quelques mois). La publication de contenu en tant qu’auteur permettra de gagner du pouvoir et de gagner en visibilité dans les SERPs.

La variété des médias

On en parlait pas plus tard que la semaine dernière en évoquant une vidéo de Matt Cutts qui répondait à un internaute s’il fallait diversifier les médias qui offrent du trafic vers son site internet. A cette question, Matt Cutts répondait par l’affirmative et, selon nous, il faut non seulement varier les médias (réseaux sociaux, blog, moteurs de recherche) mais aussi varier le type de contenu pour attirer les internautes. Infographies, articles, vidéos, graphiques, retour d’expériences, diaporamas, etc. vous permettront toujours de gagner en visibilité.

On en parlait pas plus tard que la semaine dernière en évoquant une vidéo de Matt Cutts qui répondait à un internaute s’il fallait diversifier les médias qui offrent du trafic vers son site internet. A cette question, Matt Cutts répondait par l’affirmative et, selon nous, il faut non seulement varier les médias (réseaux sociaux, blog, moteurs de recherche) mais aussi varier le type de contenu pour attirer les internautes. Infographies, articles, vidéos, graphiques, retour d’expériences, diaporamas, etc. vous permettront toujours de gagner en visibilité.

Améliorer la qualité de ses liens

Comme nous l’expliquions en préambule de cet article, le temps où les spécialistes SEO faisaient des centaines de liens à travers différents annuaires est aujourd’hui révolu. Depuis la mise à jour de Penguin 2.0, les référenceurs savent que des liens de faible qualité peuvent avoir un impact énorme sur la visibilité des sites web.

Si Google vise de plus en plus les stratégies de netlinking, on ne peut pas abandonner l’idée de construire des liens. Il faudra simplement renforcer cette stratégie en se concentrant sur des liens de haute qualité puisque tout ce qui ressemblera à un système de lien sera certainement pénalisé dans les mois ou les années à venir.

L’arrivée du mobile

Depuis un moment, l’émergence du mobile ne peut plus être ignorée puisque de plus en plus d’internautes se tournent vers les tablettes et smartphones pour surfer sur le web. Il est donc important de créer un site web qui sera adapté à ces nouvelles plateformes et qu’il offrira une expérience de qualité à l’internaute (pour rappel, seulement 9% des sites web sont Responsive Web Design comme on le rappelait dans cet article)

Source : business2community

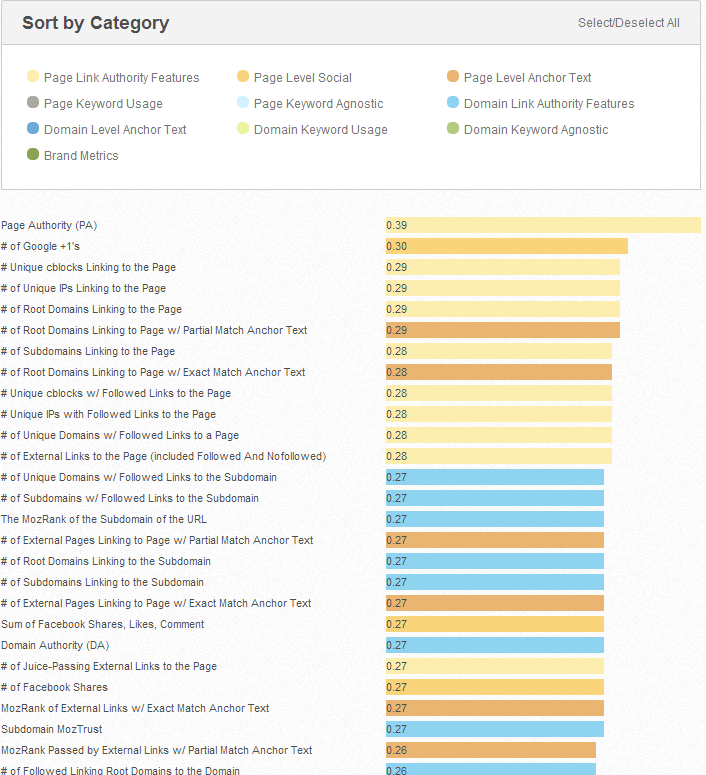

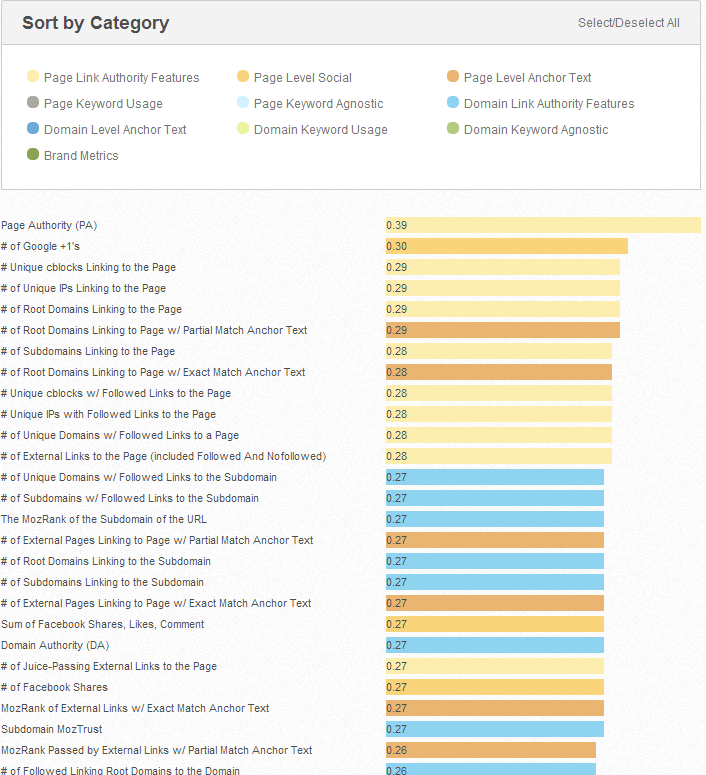

Ce mercredi (le 2 octobre 2013), le blog réputé pour ses actus dans le monde du Seo Moz.com (anciennement Seomoz) a publié une étude des facteurs qui permettent aux sites web de mieux se positionner dans les moteurs de recherche. Il s’agit d’une étude que Moz réalise tous les deux ans et qui met en évidence les éléments essentiels qui feront le futur de la recherche.

Ce mercredi (le 2 octobre 2013), le blog réputé pour ses actus dans le monde du Seo Moz.com (anciennement Seomoz) a publié une étude des facteurs qui permettent aux sites web de mieux se positionner dans les moteurs de recherche. Il s’agit d’une étude que Moz réalise tous les deux ans et qui met en évidence les éléments essentiels qui feront le futur de la recherche.

Pour réaliser cette étude, Moz.com a réalisé des enquêtes auprès de plus de 100 professionnels de l’industrie du SEO et ces informations ont été complétées par des données qui ont été étudiées par le Dr Matt Peters et son équipe sur base de plus de 17.000 mots clés.

On se souvient que Searchmetrics avait publié une infographie similaire au début de l’été et il nous semble intéressant de vous proposer cette nouvelle version proposée par Moz afin que vous puissiez comparer ces deux sources.

Les facteurs de classement, c’est quoi ?

Google explique dans ses guidelines qu’il utilise plus de 200 signaux différents dans son algorithme de recherche et personnes ne sait exactement quels sont ces signaux. Cependant, il est possible d’analyser quels sont les signaux qui ont le plus d’influence en analysant les premiers résultats du moteur de recherche. Mais attention, comme beaucoup de spécialistes du SEO l’ont déjà dit lorsque d’autres études sont parues, il ne s’agit pas de facteurs de causalité mais bien de corrélation. En effet, cette phrase de Coluche faisait bien la différence entre les deux :

Quand on est malade, il ne faut surtout pas aller à l’hôpital : la probabilité de mourir dans un lit d’hôpital est 10 fois plus grande que dans son lit à la maison

Autrement dit : Ce n’est pas parce que deux éléments peuvent être corrélés qu’il y a des rapports de cause à effet entre les deux. Voyez plutôt ici pour d’autres informations concernant la différence entre causalité et corrélation.

Corrélation et non causalité

Les facteurs mis en avant par Moz.com sont des facteurs de corrélation, c’est-à-dire que ces facteurs peuvent avoir un impact (parfois indirect) sur le classement dans les moteurs de recherche. Par exemple, on remarque dans les facteurs ci-dessous une forte corrélation entre les +1 de Google et un bon positionnement dans les moteurs de recherche. Pourtant, on sait que les +1 ne sont pas pris en compte dans les 200 signaux de Google comme Matt Cutts l’expliquait encore il y a peu.

Cependant, s’il n’y a pas de liens de causalité entre les +1 et le classement dans Google, on peut tout de même remarquer une forte corrélation entre les deux.

Les facteurs de corrélation

Les facteurs de corrélation les plus importants :

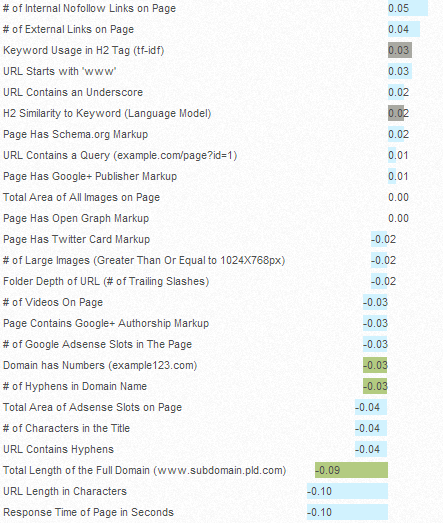

Et les moins importants (et les corrélations négatives) :

Pour découvrir l’entièreté du tableau, nous vous proposons de le lire directement sur Moz.com.

Beaucoup d’entreprises ayant déjà une présence sur le web via leur propre site web doivent régulièrement se demander s’il est intéressant pour elles de tenir un blog à jour. A cette question, on n’a pas d’autres choix que de répondre par l’affirmative puisque presque toutes les entreprises (surtout aux Etats-Unis) ont un blog donc pourquoi pas la vôtre ?

Beaucoup d’entreprises ayant déjà une présence sur le web via leur propre site web doivent régulièrement se demander s’il est intéressant pour elles de tenir un blog à jour. A cette question, on n’a pas d’autres choix que de répondre par l’affirmative puisque presque toutes les entreprises (surtout aux Etats-Unis) ont un blog donc pourquoi pas la vôtre ?

Cependant, comme l’explique bien Josh McCoy dans son article sur Searchenginewatch, les résultats d’un blog ne sont plus les mêmes qu’il y a quelques années. En effet, avant les mises à jour de Google, on pouvait utiliser un blog principalement pour y placer des contenus truffés de mots clés pour se positionner dans les premiers résultats de recherche. Mais aujourd’hui, avec Google Panda et Penguin, les données ont évolué.

Quels sont donc les réels intérêts de tenir un blog à jour ? Voici quelques indices repris sur Searchenginewatch.

Les raisons de tenir un blog

Apporter du contenu pertinent

Dans notre introduction, nous avons mis en évidence le fait que truffer les articles de son blog de mots clés ne servait plus à rien aujourd’hui (c’est même devenu contre-productif en cas de pénalité de Google). Cependant, d’un autre point de vue, rédiger des articles informatifs, percutants, attractifs et alléchants dans vos thèmes de prédilection risque bien de servir de levier pour le référencement de votre site internet.

Petit à petit, grâce à cette rédaction de qualité, vous allez tout de même pouvoir vous positionner sur certaines requêtes et cela offrira à votre site web une structure de liens plus forte.

Les partages sociaux

Depuis toujours, les entreprises doivent aller chercher les consommateurs là où ils se trouvent. Or, si il y a 10 ans, il fallait aller les chercher via la publicité dans la presse ou dans les médias tels que la télévision et la radio, aujourd’hui c’est sur le web qu’il faut aller à la rencontre des clients potentiels. Et où se trouvent la plupart de ces clients potentiels ? Sur les réseaux sociaux bien évidemment !

Depuis toujours, les entreprises doivent aller chercher les consommateurs là où ils se trouvent. Or, si il y a 10 ans, il fallait aller les chercher via la publicité dans la presse ou dans les médias tels que la télévision et la radio, aujourd’hui c’est sur le web qu’il faut aller à la rencontre des clients potentiels. Et où se trouvent la plupart de ces clients potentiels ? Sur les réseaux sociaux bien évidemment !

En plus d’aller à la rencontre des internautes sur les réseaux sociaux, le blog permettra de créer une communauté autour de votre marque et permettre à vos auditeurs de s’engager dans vos publications en les partageant, les commentant ou les « aimant ».

Bien entendu, il ne faut pas tomber dans l’excès de l’utilisation des réseaux sociaux en publiant tous les jours des articles qui font la promotion de vos services.

N’hésitez pas pour cela à ajouter des boutons de partage sur vos articles, cela permettra aux internautes de partager plus facilement vos articles !

Obtenir des liens

Pour se positionner de manière optimale dans les moteurs de recherche, nous savons qu’il est nécessaire d’obtenir des liens sur d’autres sites web. Mais combien de liens peut-on obtenir simplement à partir de la page d’accueil d’un site web, de sa page de contact ou de sa page de produits ? Pas beaucoup…

Pour obtenir de nouveaux liens pertinents, il est nécessaire de créer du contenu de qualité qui sera partagé. C’est une des meilleures recettes pour obtenir des liens.

Engager les internautes

A côté de l’engagement des internautes via les plateformes sociales et de la création des liens, un blog (tout comme un forum d’ailleurs) permet aux internautes de pouvoir intégrer votre communauté en ayant la possibilité de publier des commentaires auxquels il sera important de répondre.

La visibilité et les conversions

Ce n’est pas spécialement parce qu’on tient un blog qu’on va subitement drainer un trafic monstre ou que son site va directement se positionner dans les meilleures positions sur les moteurs de recherche. Cependant, les blogs peuvent tirer parti des avantages cités ci-dessus (réseaux sociaux, liens, etc.) pour gagner en visibilité.

Du coup, le blog apportera un certain nombre de visiteurs sur le site web ainsi qu’une visibilité accrue, ce qui offrira des possibilités de conversion en hausse.

Les raisons de ne pas tenir un blog

La suprématie de la marque

Si votre marque est suffisamment reconnue pour gagner des liens uniquement avec son nom et qu’elle détient déjà une présence sociale importante avec des dizaines de milliers de fans, vous n’avez pas besoin d’un blog.

Si votre marque est suffisamment reconnue pour gagner des liens uniquement avec son nom et qu’elle détient déjà une présence sociale importante avec des dizaines de milliers de fans, vous n’avez pas besoin d’un blog.

Cependant, même dans ce cas de figure, tenir un blog permettra d’offrir du contenu supplémentaire à vos clients et d’être un leader d’opinion dans le secteur.

En conclusion

A moins de faire partie des 2% d’entreprises qui n’ont pas besoin de blog parce qu’elles détiennent déjà un important capital affectif et une communauté sociale d’envergure, tenir à jour un blog peut s’avérer très bénéfique pour une entreprise.

Cependant, il ne faut pas croire que c’est parce qu’on tient un blog que le succès va directement suivre. Il s’agit d’un levier parmi d’autres qui permettra de drainer petit à petit un trafic ainsi que des conversions.

Vous voyez d’autres raisons à mettre en avant pour tenir un blog à jour ? N’hésitez pas à nous en faire part dans les commentaires ! 😉

De nos jours, se positionner de manière idéale sur les moteurs de recherche peut avoir une influence considérable sur les ventes et la notoriété d’une entreprise. En effet, se positionner dans les 3 premières positions pour un mot clé spécifique sur Google ou figurer en 3e page n’aura pas le même impact pour l’entreprise.

Pour se positionner le plus haut possible sur les moteurs de recherche, il faut que l’entreprise maîtrise parfaitement les stratégies Search Engine Optimization (SEO ou optimisation pour les moteurs de recherche) ou qu’elle les délègue à une agence de référencement.

Se positionner dans les premiers résultats des moteurs de recherche n’est pas chose facile et ce n’est pas donné à tout le monde. En effet, les techniques de référencement évoluent jours après jours et il faut sans cesse rester à l’affût des dernières actualités et des mises à jours des algorithmes de Google (Panda ou Penguin) pour rester dans la course.

Pour aider les entreprises qui référencent leurs sites par elles-mêmes, Act-On a réalisé une infographie résumant les principales techniques que les entreprises se doivent de maîtriser.

PS: Dans le cas où vous voudriez déléguer votre référencement, n’hésitez pas à nous contacter 😉

Via www.business2community.com